¿Hace un EJH de la astronomía?

- golondrino

- Ulema

- Mensajes: 8398

- Registrado: 23 Jun 2006 21:30

Re: ¿Hace un EJH de la astronomía?

Mientras haga bien su trabajo, que vista como le salga del nardo.

Ishkhaqwi ai durugnul!

- electroconvulsivo

- Perro infiel amiricano

- Mensajes: 23

- Registrado: 29 Oct 2014 14:32

Re: ¿Hace un EJH de la astronomía?

Un pelín tarde, pero... visteis los rebotes de Philæ captados por la OSIRIS?

Las fotos de ese cacharro pueden ser impresionantes, a ver si van saliendo más. En fin, a ver si al acercarse al perihelio resucita...

Las fotos de ese cacharro pueden ser impresionantes, a ver si van saliendo más. En fin, a ver si al acercarse al perihelio resucita...

Re: ¿Hace un EJH de la astronomía?

Eso sí que es una derrapada.

The Fast and the Furious: 67P/Churiumov-Guerasimenko Drift!

The Fast and the Furious: 67P/Churiumov-Guerasimenko Drift!

"Apathy's a tragedy

And boredom is a crime"

GNU Terry Pratchett

And boredom is a crime"

GNU Terry Pratchett

Re: ¿Hace un EJH de la astronomía?

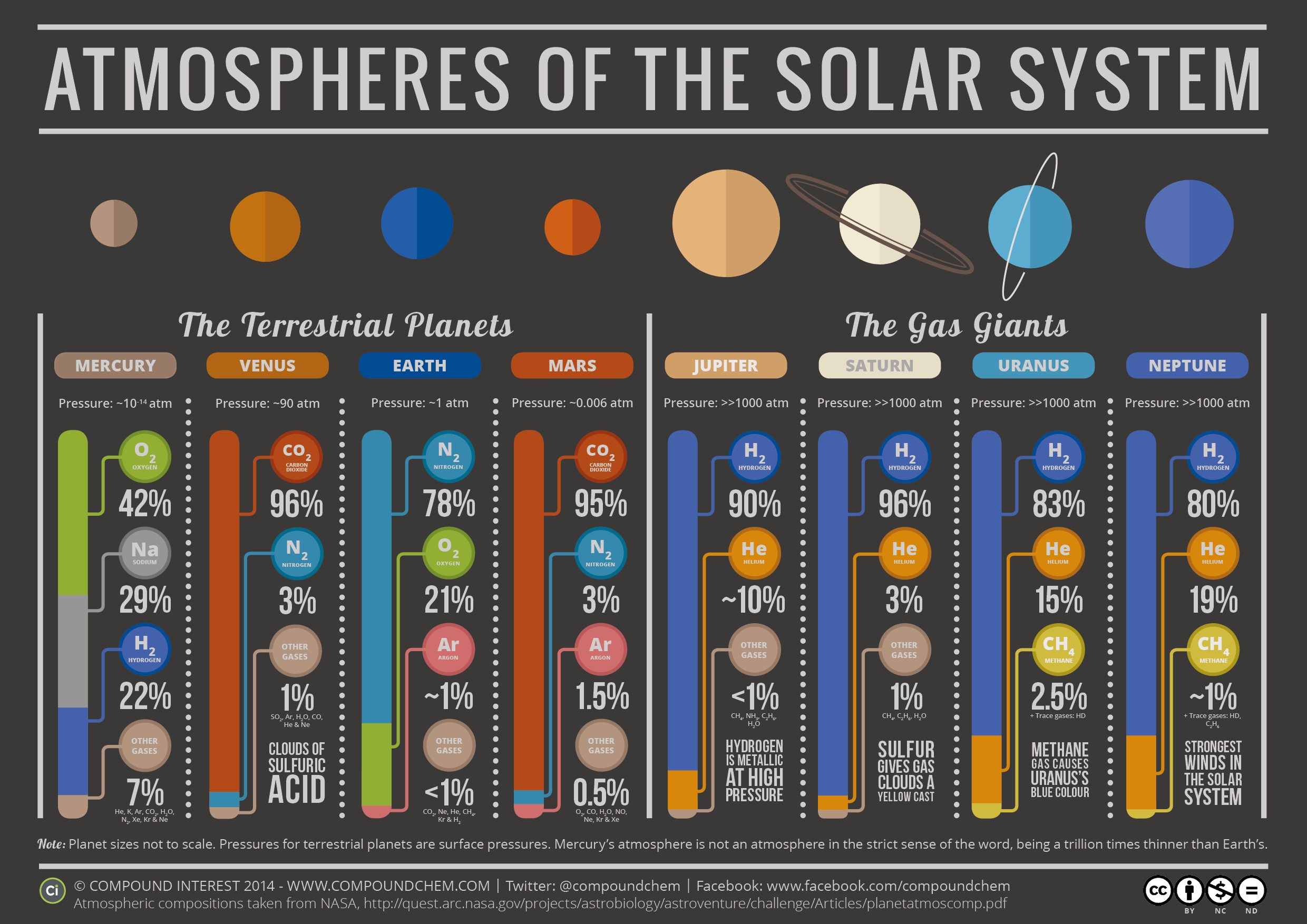

Space Facts: http://imgur.com/gallery/duSHQ

Hay unos cuantos interesantes y varias fotos molonas.

Lo de la paradoja de Fermi daría para una buena discusión (con unas cuantas birras encima).

Hay unos cuantos interesantes y varias fotos molonas.

Lo de la paradoja de Fermi daría para una buena discusión (con unas cuantas birras encima).

"Apathy's a tragedy

And boredom is a crime"

GNU Terry Pratchett

And boredom is a crime"

GNU Terry Pratchett

Re: ¿Hace un EJH de la astronomía?

"Apathy's a tragedy

And boredom is a crime"

GNU Terry Pratchett

And boredom is a crime"

GNU Terry Pratchett

- Juggernaut

- Hombre de Mundo

- Mensajes: 4989

- Registrado: 02 Ago 2003 12:35

- Ubicación: en una galaxia lejana, muy lejana

Re: ¿Hace un EJH de la astronomía?

Ah, la paradoja de Fermi... cuantos pensamientos al respecto.

Para el que no lo sepa: La paradoja de Fermi es: "donde está todo el mundo"? Vale, que las probabilidades que haya miles y millones de civilizaciones inteligentes como la nuestra son tremendamente altas, solo a la vista de los trillones y cuatrillones de escenarios disponibles para que se desarrollen... pero si es así, donde están? Como es que no se muestran? Como es que no las vemos ni las oímos ni estamos rodeados por radiación de comunicaciones de ellas por todas partes?

Había miles de explicaciones, desde la primera directiva de Star Trek hasta que realmente es tan rara la vida inteligente que solo estamos nosotros.

Si quieres saber mi conclusión final: La paradoja de Fermi no es ninguna paradoja. Simplemente es que no nos damos ni puta cuenta de lo grande que es esto. Nuestro cerebro no abarca qué coño quiere decir millones de galaxias con trillones de estrellas en todo ese espacio, y pensamos que si hay algo más debe estar como aquí al lado. Y a ver, tenemos a nuestro alrededor una pelotita de radiación de 50 años luz (los años que llevamos transmitiendo al espacio), y la analogía sería que para la vida inteligente que pueda haber ahí fuera, darse cuenta que hay radiación en una pelotita de 50 años luz, debe ser como darse cuenta que en un grano de arena de una playa en concreto hay microbios. A poco que hayas caído un poco lejos de donde está la fiesta, no te van a detectar en mucho tiempo.

Y quizá sea mejor así...

La novela (y película) "Contact" de Sagan utiliza esa misma premisa, y asimismo "Star Trek primer contacto", o "Partida de Rescate" de Clarke... en todos estos guiones de ciencia ficción, se supone que el momento en que el resto del universo se de cuenta de que estamos ahí, es por diversos factores: Contact, porque por fin llega la señal a algún sitio donde alguien se da cuenta de que estamos ahí, Star Trek Primer Contacto porque por fin alguien usa un motor de curvatura, y eso de repente se detecta desde mucho más lejos que la radiación, y Partida de Rescate porque el sol está a punto de convertirse en nova, y entonces se dan cuenta que ahí había una civilización (nosotros) que ha decidido pirarse a velocidad sublimínica.

Creo sinceramente que el juego este de la civilización es bastante equilibrado: No nos verán hasta que no estemos preparados para que nos vean, es decir, no tendremos noticias ni seremos notados por otras civilizaciones que hayan dado el salto fuera de su sistema hasta que no tengamos tecnología suficiente como para dar el salto a otro sistema. Más o menos, quiero decir que mientras solo puedas usar radiación y moverte quemando cosas, no te va a ver nadie fuera de aquí, pero en cuanto seas capaz de usar lo necesario para moverte entre sistemas (provocar agujeros de gusano, derivar energía de vacío, o lo que sea) entonces si que eso se verá desde lejos, e implicará que estaremos lo suficientemente avanzados como para defendernos de lo que podamos encontrar. Lo que pasa es que para llegar hasta ese nivel, necesitamos muchísima más capacidad. Las cerraduras del universo son cada vez más complicadas, y solo las puedes abrir cuando llegas a un nivel mayor. Y aquí ha de pasar algo gordo para que cambiemos de paradigma... el método científico y los cerebros humanos trabajando juntos con sus egoísmos y sus políticas está claro que ya no dan mucho más de si para llegar más lejos.

Para el que no lo sepa: La paradoja de Fermi es: "donde está todo el mundo"? Vale, que las probabilidades que haya miles y millones de civilizaciones inteligentes como la nuestra son tremendamente altas, solo a la vista de los trillones y cuatrillones de escenarios disponibles para que se desarrollen... pero si es así, donde están? Como es que no se muestran? Como es que no las vemos ni las oímos ni estamos rodeados por radiación de comunicaciones de ellas por todas partes?

Había miles de explicaciones, desde la primera directiva de Star Trek hasta que realmente es tan rara la vida inteligente que solo estamos nosotros.

Si quieres saber mi conclusión final: La paradoja de Fermi no es ninguna paradoja. Simplemente es que no nos damos ni puta cuenta de lo grande que es esto. Nuestro cerebro no abarca qué coño quiere decir millones de galaxias con trillones de estrellas en todo ese espacio, y pensamos que si hay algo más debe estar como aquí al lado. Y a ver, tenemos a nuestro alrededor una pelotita de radiación de 50 años luz (los años que llevamos transmitiendo al espacio), y la analogía sería que para la vida inteligente que pueda haber ahí fuera, darse cuenta que hay radiación en una pelotita de 50 años luz, debe ser como darse cuenta que en un grano de arena de una playa en concreto hay microbios. A poco que hayas caído un poco lejos de donde está la fiesta, no te van a detectar en mucho tiempo.

Y quizá sea mejor así...

La novela (y película) "Contact" de Sagan utiliza esa misma premisa, y asimismo "Star Trek primer contacto", o "Partida de Rescate" de Clarke... en todos estos guiones de ciencia ficción, se supone que el momento en que el resto del universo se de cuenta de que estamos ahí, es por diversos factores: Contact, porque por fin llega la señal a algún sitio donde alguien se da cuenta de que estamos ahí, Star Trek Primer Contacto porque por fin alguien usa un motor de curvatura, y eso de repente se detecta desde mucho más lejos que la radiación, y Partida de Rescate porque el sol está a punto de convertirse en nova, y entonces se dan cuenta que ahí había una civilización (nosotros) que ha decidido pirarse a velocidad sublimínica.

Creo sinceramente que el juego este de la civilización es bastante equilibrado: No nos verán hasta que no estemos preparados para que nos vean, es decir, no tendremos noticias ni seremos notados por otras civilizaciones que hayan dado el salto fuera de su sistema hasta que no tengamos tecnología suficiente como para dar el salto a otro sistema. Más o menos, quiero decir que mientras solo puedas usar radiación y moverte quemando cosas, no te va a ver nadie fuera de aquí, pero en cuanto seas capaz de usar lo necesario para moverte entre sistemas (provocar agujeros de gusano, derivar energía de vacío, o lo que sea) entonces si que eso se verá desde lejos, e implicará que estaremos lo suficientemente avanzados como para defendernos de lo que podamos encontrar. Lo que pasa es que para llegar hasta ese nivel, necesitamos muchísima más capacidad. Las cerraduras del universo son cada vez más complicadas, y solo las puedes abrir cuando llegas a un nivel mayor. Y aquí ha de pasar algo gordo para que cambiemos de paradigma... el método científico y los cerebros humanos trabajando juntos con sus egoísmos y sus políticas está claro que ya no dan mucho más de si para llegar más lejos.

Este es un mundo de estúpidos, controlados por imbéciles, para beneficio de mediocres.

Re: ¿Hace un EJH de la astronomía?

Yo creo que la cosa es un poquito más complicada.

En parte sí, es esto tan grande que nuestra mini burbuja de radiación no llega a nada ni el universo visible es una parte lo suficientemente significativa como para decir que lo que vemos es la norma, así que bien pudiera ser que el universo esté lleno de civilizaciones espaciales pero es tan grande que ese "lleno" no signifique demasiado, puede haber una civilización espacial por galaxia, lo que nos daría miles y miles de ellas y estarían tan lejos de detectarnos como el ejemplo de Jugger de detectar unos microbios específicos en un grano de arena.

Poromplo, nuestra burbuja de radiación tiene unos 50 o 60 años luz, pero tan solo nuestra galaxia mide 100.000 años luz, ni hablar del espacio entre las galaxias ni del tamaño de ellas.

Otra posibilidad importante es una especie de hipotético filtro que hace que la vida inteligente o mejor dicho las civilizaciones espaciales sean mucho más raras de lo que pensamos. Para que existan se tiene que dar toda una cadena de eventos muy delicados. Piensen en nosotros mismos, lo increíblemente frágiles que somos, un cometa bien puesto y chau tierra, o ni eso, un mísero virus que se ponga las pilas y nos limpia a todos, dejando un hermoso planeta lleno de vida pero sin humanos que enviar señales de radio y ni hablar de que al avanzar una civilización y descubrir la clase de cosas que hace falta descubrir para llegar a las estrellas, es cada vez más probable que por error o malicia se use mal esa tecnología y un simple error o una guerra termine limpiando a todos.

Lo interesante del filtro ese es que no sabemos si se encuentra en nuestro pasado o en nuestro futuro, que tal vez sea una barrera evolutiva que nuestra especie cruzó sin darnos cuenta o que puede ser algo que todavía nos queda por enfrentar, que puede ser una revolución tecnológica, cambios radicales de pensamiento y hasta cambios sociales.

Otra posibilidad, esta basada en recientes descubrimientos genéticos y cosas que están muy por encima de mi nivel, habla de la Panspermia, la posibilidad de que la vida en la tierra venga de otros planetas, esto es significativo si se analiza que, según esos nuevos descubrimientos de los que hablaba, se tiene que la evolución de la vida lleva más de los 14 mil millones de años de nuestro planeta, aparentemente puede que la vida haya tenido billones de años para evolucionar y puede que recién se esté llegando al punto en el que nuestro universo puede producir vida inteligente por primera vez.

Así que pueden ser todos esos factores juntos: Tamaño de todo el chiringuito este del universo, rareza de las especies, que nos eviten y hasta que nosotros seamos los primeros.

Esto que dices:

Es algo a lo que yo llevo dándole vueltas hace rato, no solo en lo científico en el que las ramas de la ciencia son cada vez más complejas y especializadas y los descubrimientos radicales hacen necesario un conocimiento de varias de ellas a la vez, haciendo más y más difícil que una persona o un grupo de personas puedan avanzar más allá de cierto punto. Pero también en lo social, económico, político, etc... cada vez más vemos que los sistemas que tenemos funcionan peor y peor para cubrir lo que se requiere de ellos y no se nos ocurre ni somos capaces de aceptar (globalmente) sistemas alternativos que puedan dar soluciones mejores.

A mi, la única solución que se me ocurre, es que lleguemos a aguantar hasta la singularidad tecnológica, que parece estar cada vez más cerca, una vez que seamos capaces de crear una computadora inteligente y darle nuestros conocimientos y dejar que ella diseñe un nuevo modelo, el aumento de la inteligencia artificial puede ser exponencial y se puede aplicar a resolver todos los problemas que tenemos.

También puede ser que nos barran a todos a lo Terminator, pero tampoco me parecería tan ilógico, podría ser un paso normal en la evolución de las especies, llegar al punto en el que pueden crear vida artificial autorreplicante y "cerderle el lugar" a esta, que por otra parte estaría mucho mejor preparada para recorrer y poblar el universo. Con un poquito de suerte vamos a aprender a poner nuestros cerebros o conciencia o lo que sea en las máquinas y van a ser nuestros hijos y no nuestros ordenadores los que van a plantar banderitas en otros planetas.

En parte sí, es esto tan grande que nuestra mini burbuja de radiación no llega a nada ni el universo visible es una parte lo suficientemente significativa como para decir que lo que vemos es la norma, así que bien pudiera ser que el universo esté lleno de civilizaciones espaciales pero es tan grande que ese "lleno" no signifique demasiado, puede haber una civilización espacial por galaxia, lo que nos daría miles y miles de ellas y estarían tan lejos de detectarnos como el ejemplo de Jugger de detectar unos microbios específicos en un grano de arena.

Poromplo, nuestra burbuja de radiación tiene unos 50 o 60 años luz, pero tan solo nuestra galaxia mide 100.000 años luz, ni hablar del espacio entre las galaxias ni del tamaño de ellas.

Otra posibilidad importante es una especie de hipotético filtro que hace que la vida inteligente o mejor dicho las civilizaciones espaciales sean mucho más raras de lo que pensamos. Para que existan se tiene que dar toda una cadena de eventos muy delicados. Piensen en nosotros mismos, lo increíblemente frágiles que somos, un cometa bien puesto y chau tierra, o ni eso, un mísero virus que se ponga las pilas y nos limpia a todos, dejando un hermoso planeta lleno de vida pero sin humanos que enviar señales de radio y ni hablar de que al avanzar una civilización y descubrir la clase de cosas que hace falta descubrir para llegar a las estrellas, es cada vez más probable que por error o malicia se use mal esa tecnología y un simple error o una guerra termine limpiando a todos.

Lo interesante del filtro ese es que no sabemos si se encuentra en nuestro pasado o en nuestro futuro, que tal vez sea una barrera evolutiva que nuestra especie cruzó sin darnos cuenta o que puede ser algo que todavía nos queda por enfrentar, que puede ser una revolución tecnológica, cambios radicales de pensamiento y hasta cambios sociales.

Otra posibilidad, esta basada en recientes descubrimientos genéticos y cosas que están muy por encima de mi nivel, habla de la Panspermia, la posibilidad de que la vida en la tierra venga de otros planetas, esto es significativo si se analiza que, según esos nuevos descubrimientos de los que hablaba, se tiene que la evolución de la vida lleva más de los 14 mil millones de años de nuestro planeta, aparentemente puede que la vida haya tenido billones de años para evolucionar y puede que recién se esté llegando al punto en el que nuestro universo puede producir vida inteligente por primera vez.

Así que pueden ser todos esos factores juntos: Tamaño de todo el chiringuito este del universo, rareza de las especies, que nos eviten y hasta que nosotros seamos los primeros.

Esto que dices:

Jugger escribió:Las cerraduras del universo son cada vez más complicadas, y solo las puedes abrir cuando llegas a un nivel mayor. Y aquí ha de pasar algo gordo para que cambiemos de paradigma... el método científico y los cerebros humanos trabajando juntos con sus egoísmos y sus políticas está claro que ya no dan mucho más de si para llegar más lejos.

Es algo a lo que yo llevo dándole vueltas hace rato, no solo en lo científico en el que las ramas de la ciencia son cada vez más complejas y especializadas y los descubrimientos radicales hacen necesario un conocimiento de varias de ellas a la vez, haciendo más y más difícil que una persona o un grupo de personas puedan avanzar más allá de cierto punto. Pero también en lo social, económico, político, etc... cada vez más vemos que los sistemas que tenemos funcionan peor y peor para cubrir lo que se requiere de ellos y no se nos ocurre ni somos capaces de aceptar (globalmente) sistemas alternativos que puedan dar soluciones mejores.

A mi, la única solución que se me ocurre, es que lleguemos a aguantar hasta la singularidad tecnológica, que parece estar cada vez más cerca, una vez que seamos capaces de crear una computadora inteligente y darle nuestros conocimientos y dejar que ella diseñe un nuevo modelo, el aumento de la inteligencia artificial puede ser exponencial y se puede aplicar a resolver todos los problemas que tenemos.

También puede ser que nos barran a todos a lo Terminator, pero tampoco me parecería tan ilógico, podría ser un paso normal en la evolución de las especies, llegar al punto en el que pueden crear vida artificial autorreplicante y "cerderle el lugar" a esta, que por otra parte estaría mucho mejor preparada para recorrer y poblar el universo. Con un poquito de suerte vamos a aprender a poner nuestros cerebros o conciencia o lo que sea en las máquinas y van a ser nuestros hijos y no nuestros ordenadores los que van a plantar banderitas en otros planetas.

"Apathy's a tragedy

And boredom is a crime"

GNU Terry Pratchett

And boredom is a crime"

GNU Terry Pratchett

- Juggernaut

- Hombre de Mundo

- Mensajes: 4989

- Registrado: 02 Ago 2003 12:35

- Ubicación: en una galaxia lejana, muy lejana

Re: ¿Hace un EJH de la astronomía?

Curiosamente has llegado a la misma conclusión a la que yo llegué hace muuuucho tiempo, que nos debíamos concentrar en la IA, que iba a ser la única respuesta posible para seguir avanzando.

NO me atreví a ponerla en el post anterior, porque me daba miedo ya pasarme de la ralla diciendo animaladas, así que intenté dejar la pista para ver si salía en el debate, y zasca ahí vienes tu a recoger el guante.

La verdad es que no se ni si llamar "discusión" a esto, pues estamos absolutamente de acuerdo en todo.

Primero: Has lanzado otra pelota que yo llevo tiempo dándole vueltas: Y si realmente la evolución de la vida no empezó en nuestro planeta? Incluso yo había llegado más lejos: Y si no empezó en este universo? Una de las teorías que me he inventao más molonas era que el modelo verdadero final del universo era el big bang y big crunch una vez y otra... y me había imaginado, en cada partida de big bang, a un montón de especies apareciendo, peleándose, que solo quede una, y que esa especie, durante el big crunch, consigue dejar las cosas preparadas con todo el conocimiento que ha acumulado, para que en el próximo big bang aparezca una nueva molécula de vida un poco más evolucionada, que consiga que aparezca la vida inteligente antes que en la iteración anterior. Oye, como argumento para una serie de ciencia ficción, no veas si da. Así molaría, porque realmente la vida si que ha sido creada por un dios... nosotros mismos en la iteración anterior.

Pero me gusta mucho más la otra pelota: La de la IA. Yo siempre he pensado que nosotros tendemos al homocentrismo: Pensábamos que la tierra era plana porque nosotros la veíamos plana, pensábamos que no había otros planetas porque no los veíamos, y muchas más cosas parecidas. Asimismo pienso que en inteligencia, también pensamos que lo nuestro es lo mejor que se puede conseguir, porque no hemos visto nada más. Y creo que en cuanto consigamos sintetizarla, descubriremos que nuestros cerebros son una puta mierda pinchada en un palo. Reconozcámoslo, no somos capaces de recordar más de 6 o 7 elementos a la vez, y podremos hacer muchas cosas, pero nos cuesta programar un simple robotito que vuele mejor que una puta mosca.

Y es que eso de que nuestra inteligencia es de lo mejorcito que hay, discrepo un montón. A ver, el juego evolutivo te garantiza que sigues evolucionando hasta que consigues dominar tu entorno. Una vez lo consigues, game over. Se acaba el juego evolutivo. No hay ya avances en nuestro cerebro, ya que nuestra supervivencia y la de nuestra descendencia está garantizada, por otros motivos que por nuestro fenotipo, por tanto la evolución paró con nosotros (si hay más cambios serán por otros motivos, pero no por la supervivencia del más adaptado). Es probable que nos hayamos quedado a las puertas de la verdadera inteligencia, del verdadero conocimiento. Y que se supone que ahora el juego sigue haciendo nosotros "a mano" lo que la evolución ha hecho con nosotros desde hace mucho. Es como si la evolución fuera la corriente de un río, y hemos llegado al mar. Nuestra inteligencia la medimos por la profundidad del agua debajo nuestro, y en el río era menos, y ahora tenemos 30 metros por debajo y pensamos que hemos llegado al tope porque la corriente ya no nos lleva. Y lo que se está esperando de nosotros es que construyamos unos remos o un motor, y entonces podremos llegar a la fosa de las marianas, donde hay 13.000 metros de profundidad.

Y es que puede que no podamos hacerlo, tal como lo estamos intentando. Existen ciertos indicios en teoría de computación (lenguajes, gramáticas, autómatas y esas cosas) que dice que un sistema que tiene una complejidad X, o bien una gramática que es capaz de generar lenguajes con una complejidad X, no puede generar lenguajes de una complejidad mayor, ni siquiera lenguajes con su propia complejidad. Viene a decir que a lo mejor lo que nos ocurre es que nos va a ser imposible construir un modelo de inteligencia más avanzado que el nuestro (o siquiera de nuestro nivel), porque somos incapaces de hacerlo. Es una vieja premisa la que dice el efecto no puede superar a la causa en perfección.

Pero eso si: Si nuestra inteligencia ha salido de un sistema evolutivo, que tiene unas reglas determinadas que aumentan la complejidad y permiten llegar hasta nosotros, quizá podamos emular ese proceso evolutivo y avanzarlo, y por tanto llegar a conseguir esos remos hipotéticos que nos lleven más allá.

Y es que es otra cosa que siempre he visto tanto en literatura como en las opiniones de la gente, otra vez es ese mismo homocentrismo: Que nuestra inteligencia es similar a la que podremos conseguir sintetizar. Y estoy convencido de que no, que una IA nos dará 10.000 vueltas.

Y un último apunte de homocentrismo: Que si la IA es más poderosa, nos exterminará. Por? Coño, yo si consigo una IA que funciona mejor que yo, sabes lo que querré? Modificarme a mi mismo para conseguir llegar a ser como ella! El homocentrismo en este caso es pensar que no sabremos nunca como modificarnos a nosotros mismos. Y es que una IA que realmente llegara más lejos que nosotros le daría tantas vueltas a la medicina... Fijate que para arreglar un ojo los médicos solo saben cortar, segar, quemar e implantar... ni puta idea de como hacerlo crecer. Quién dice que no podremos hacerlo cuando consigamos descubrir de verdad como funciona nuestro cuerpo, y dejemos de confiar en esos médicos que solo saben de albañilería?

Bueno, ya paro que me animo demasiado.

NO me atreví a ponerla en el post anterior, porque me daba miedo ya pasarme de la ralla diciendo animaladas, así que intenté dejar la pista para ver si salía en el debate, y zasca ahí vienes tu a recoger el guante.

La verdad es que no se ni si llamar "discusión" a esto, pues estamos absolutamente de acuerdo en todo.

Primero: Has lanzado otra pelota que yo llevo tiempo dándole vueltas: Y si realmente la evolución de la vida no empezó en nuestro planeta? Incluso yo había llegado más lejos: Y si no empezó en este universo? Una de las teorías que me he inventao más molonas era que el modelo verdadero final del universo era el big bang y big crunch una vez y otra... y me había imaginado, en cada partida de big bang, a un montón de especies apareciendo, peleándose, que solo quede una, y que esa especie, durante el big crunch, consigue dejar las cosas preparadas con todo el conocimiento que ha acumulado, para que en el próximo big bang aparezca una nueva molécula de vida un poco más evolucionada, que consiga que aparezca la vida inteligente antes que en la iteración anterior. Oye, como argumento para una serie de ciencia ficción, no veas si da. Así molaría, porque realmente la vida si que ha sido creada por un dios... nosotros mismos en la iteración anterior.

Pero me gusta mucho más la otra pelota: La de la IA. Yo siempre he pensado que nosotros tendemos al homocentrismo: Pensábamos que la tierra era plana porque nosotros la veíamos plana, pensábamos que no había otros planetas porque no los veíamos, y muchas más cosas parecidas. Asimismo pienso que en inteligencia, también pensamos que lo nuestro es lo mejor que se puede conseguir, porque no hemos visto nada más. Y creo que en cuanto consigamos sintetizarla, descubriremos que nuestros cerebros son una puta mierda pinchada en un palo. Reconozcámoslo, no somos capaces de recordar más de 6 o 7 elementos a la vez, y podremos hacer muchas cosas, pero nos cuesta programar un simple robotito que vuele mejor que una puta mosca.

Y es que eso de que nuestra inteligencia es de lo mejorcito que hay, discrepo un montón. A ver, el juego evolutivo te garantiza que sigues evolucionando hasta que consigues dominar tu entorno. Una vez lo consigues, game over. Se acaba el juego evolutivo. No hay ya avances en nuestro cerebro, ya que nuestra supervivencia y la de nuestra descendencia está garantizada, por otros motivos que por nuestro fenotipo, por tanto la evolución paró con nosotros (si hay más cambios serán por otros motivos, pero no por la supervivencia del más adaptado). Es probable que nos hayamos quedado a las puertas de la verdadera inteligencia, del verdadero conocimiento. Y que se supone que ahora el juego sigue haciendo nosotros "a mano" lo que la evolución ha hecho con nosotros desde hace mucho. Es como si la evolución fuera la corriente de un río, y hemos llegado al mar. Nuestra inteligencia la medimos por la profundidad del agua debajo nuestro, y en el río era menos, y ahora tenemos 30 metros por debajo y pensamos que hemos llegado al tope porque la corriente ya no nos lleva. Y lo que se está esperando de nosotros es que construyamos unos remos o un motor, y entonces podremos llegar a la fosa de las marianas, donde hay 13.000 metros de profundidad.

Y es que puede que no podamos hacerlo, tal como lo estamos intentando. Existen ciertos indicios en teoría de computación (lenguajes, gramáticas, autómatas y esas cosas) que dice que un sistema que tiene una complejidad X, o bien una gramática que es capaz de generar lenguajes con una complejidad X, no puede generar lenguajes de una complejidad mayor, ni siquiera lenguajes con su propia complejidad. Viene a decir que a lo mejor lo que nos ocurre es que nos va a ser imposible construir un modelo de inteligencia más avanzado que el nuestro (o siquiera de nuestro nivel), porque somos incapaces de hacerlo. Es una vieja premisa la que dice el efecto no puede superar a la causa en perfección.

Pero eso si: Si nuestra inteligencia ha salido de un sistema evolutivo, que tiene unas reglas determinadas que aumentan la complejidad y permiten llegar hasta nosotros, quizá podamos emular ese proceso evolutivo y avanzarlo, y por tanto llegar a conseguir esos remos hipotéticos que nos lleven más allá.

Y es que es otra cosa que siempre he visto tanto en literatura como en las opiniones de la gente, otra vez es ese mismo homocentrismo: Que nuestra inteligencia es similar a la que podremos conseguir sintetizar. Y estoy convencido de que no, que una IA nos dará 10.000 vueltas.

Y un último apunte de homocentrismo: Que si la IA es más poderosa, nos exterminará. Por? Coño, yo si consigo una IA que funciona mejor que yo, sabes lo que querré? Modificarme a mi mismo para conseguir llegar a ser como ella! El homocentrismo en este caso es pensar que no sabremos nunca como modificarnos a nosotros mismos. Y es que una IA que realmente llegara más lejos que nosotros le daría tantas vueltas a la medicina... Fijate que para arreglar un ojo los médicos solo saben cortar, segar, quemar e implantar... ni puta idea de como hacerlo crecer. Quién dice que no podremos hacerlo cuando consigamos descubrir de verdad como funciona nuestro cuerpo, y dejemos de confiar en esos médicos que solo saben de albañilería?

Bueno, ya paro que me animo demasiado.

Este es un mundo de estúpidos, controlados por imbéciles, para beneficio de mediocres.

Re: ¿Hace un EJH de la astronomía?

Así me gustan estos hilos a mi, llenos de teorías y desvaríos varios.

Tu teoría de la vida post-universal es interesante, en algún lugar leí una teoría similar, sobre que una especie lo suficientemente avanzada podría "escudarse" del big crunch y no sólo sobrevivir si no afectar el big bang de manera que el próximo universo creado sea más apto para ellos. Lo tuyo sería una versión simplificada y de eso.

Yo a eso le veo dos problemas, el primero es que requiere universos cíclicos y no estoy del todo convencido de eso, creo que es sólo otra manera de decir "tortugas todo hasta abajo" y la segunda es que, cualquier universo creado sería tan vasto y con condiciones tan dispares en sus diferentes regiones que no habría necesidad de crear un universo con X condiciones para hacerlo más apto para la vida (o en tu caso, para que la vida salga un poquito más rápido). Dado un universo lo bastante gande y complejo (como el nuestro) puedes encontrar regiones con condiciones para todos los gustos y lo suficientemente diversas como para garantizar que la vida surja apenas sea posible, y si uno de todas maneras quisieras hacerlo necesitarías un ordenador capaz de modelizar el universo o por lo menos su creación a partir de unas condiciones iniciales sumamente exactas y complejas.

En lo de las IA estoy completamente de acuerdo, es que sería la panacea, por algo es bien llamado "la singularidad", porque después de eso no sabemos que viene. Nuestra evolución tecnológica hasta el momento es gradual, con algunos saltos grandes y lagunas, pero progresiva y predecible... después de la singularidad es todo diferente, progreso explosivo, se pueden crear inteligencias que sean a la nuestra como la nuestra es a la de una hormiga, capaces de niveles casi ilimitados de análisis y recolección de datos. Bastaría con tirar ordenadores a cualquier problema que tengamos y se vuelve solucionable, nuestro propio "Pensamiento Profundo", ahí tienes otra concepción de Dios.

El tema de que las IA nos destruyan viene precisamente del antropocentrismo que nombras, la idea preconcebida de que cualquier inteligencia va a pensar como nosotros y va a considerar que somos inferiores y pasar de nosotros o destruirnos para que no la molestemos. Que vamos, puede ser posible, pero es un riesgo aceptable cuando lo pesas contra todo lo que mencionaba antes.

Tu teoría de la vida post-universal es interesante, en algún lugar leí una teoría similar, sobre que una especie lo suficientemente avanzada podría "escudarse" del big crunch y no sólo sobrevivir si no afectar el big bang de manera que el próximo universo creado sea más apto para ellos. Lo tuyo sería una versión simplificada y de eso.

Yo a eso le veo dos problemas, el primero es que requiere universos cíclicos y no estoy del todo convencido de eso, creo que es sólo otra manera de decir "tortugas todo hasta abajo" y la segunda es que, cualquier universo creado sería tan vasto y con condiciones tan dispares en sus diferentes regiones que no habría necesidad de crear un universo con X condiciones para hacerlo más apto para la vida (o en tu caso, para que la vida salga un poquito más rápido). Dado un universo lo bastante gande y complejo (como el nuestro) puedes encontrar regiones con condiciones para todos los gustos y lo suficientemente diversas como para garantizar que la vida surja apenas sea posible, y si uno de todas maneras quisieras hacerlo necesitarías un ordenador capaz de modelizar el universo o por lo menos su creación a partir de unas condiciones iniciales sumamente exactas y complejas.

En lo de las IA estoy completamente de acuerdo, es que sería la panacea, por algo es bien llamado "la singularidad", porque después de eso no sabemos que viene. Nuestra evolución tecnológica hasta el momento es gradual, con algunos saltos grandes y lagunas, pero progresiva y predecible... después de la singularidad es todo diferente, progreso explosivo, se pueden crear inteligencias que sean a la nuestra como la nuestra es a la de una hormiga, capaces de niveles casi ilimitados de análisis y recolección de datos. Bastaría con tirar ordenadores a cualquier problema que tengamos y se vuelve solucionable, nuestro propio "Pensamiento Profundo", ahí tienes otra concepción de Dios.

El tema de que las IA nos destruyan viene precisamente del antropocentrismo que nombras, la idea preconcebida de que cualquier inteligencia va a pensar como nosotros y va a considerar que somos inferiores y pasar de nosotros o destruirnos para que no la molestemos. Que vamos, puede ser posible, pero es un riesgo aceptable cuando lo pesas contra todo lo que mencionaba antes.

"Apathy's a tragedy

And boredom is a crime"

GNU Terry Pratchett

And boredom is a crime"

GNU Terry Pratchett

- Dolordebarriga

- Companys con diarrea

- Mensajes: 18660

- Registrado: 06 Nov 2002 20:38

- Ubicación: Ambigua

Re: ¿Hace un EJH de la astronomía?

POR DESGRACIA YA SE ME PASÓ LA INDIGNACIÓN. DE UN TIEMPO A ESTA PARTE TODO ME VALE VERGA. MAL, TODO MAL.